目录

1、插入数据

2、主键优化

2.1 数据组织方式

2.2 页分裂

2.3 页合并

2.4 主键设计原则

3、order by 优化

4、group by优化

5、limit优化

6、count 优化

1、插入数据

如果我们需要一次性往数据库表中插入多条记录,可以从以下三个方面进行优化。

1、批量插入数据

Insert into student values (5, '小明',20011019), (6, '小红',19991019), (7, '小绿',20001019);2、手动控制事务

start transaction; Insert into student values (5, '小明', 20011019), (6, '小红', 19991019), (7, '小绿', 20001019); Insert into student values (8, '小明', 20011019), (9, '小红', 19991019), (10, '小绿', 20001019); Insert into student values (11, '小明', 20011019), (12, '小红', 19991019), (13, '小绿', 20001019); commit;3、主键顺序插入,性能要高于乱序插入。

主键乱序插入 : 8 1 9 21 88 2 4 15 89 5 7 3 主键顺序插入 : 1 2 3 4 5 7 8 9 15 21 88 89

大批量插入数据

如果一次性需要插入大批量数据(比如: 几百万的记录),使用insert语句插入性能较低,此时可以使用MySQL数据库提供的load指令进行插入。操作如下:

1 、创建表结构

CREATE TABLE `tb_user` ( `id` INT(11) NOT NULL AUTO_INCREMENT, `username` VARCHAR(50) NOT NULL, `password` VARCHAR(50) NOT NULL, `name` VARCHAR(20) NOT NULL, `birthday` DATE DEFAULT NULL, `sex` CHAR(1) DEFAULT NULL, PRIMARY KEY (`id`), UNIQUE KEY `unique_user_username` (`username`) ) ENGINE = INNODB DEFAULT CHARSET = utf8;2、设置参数

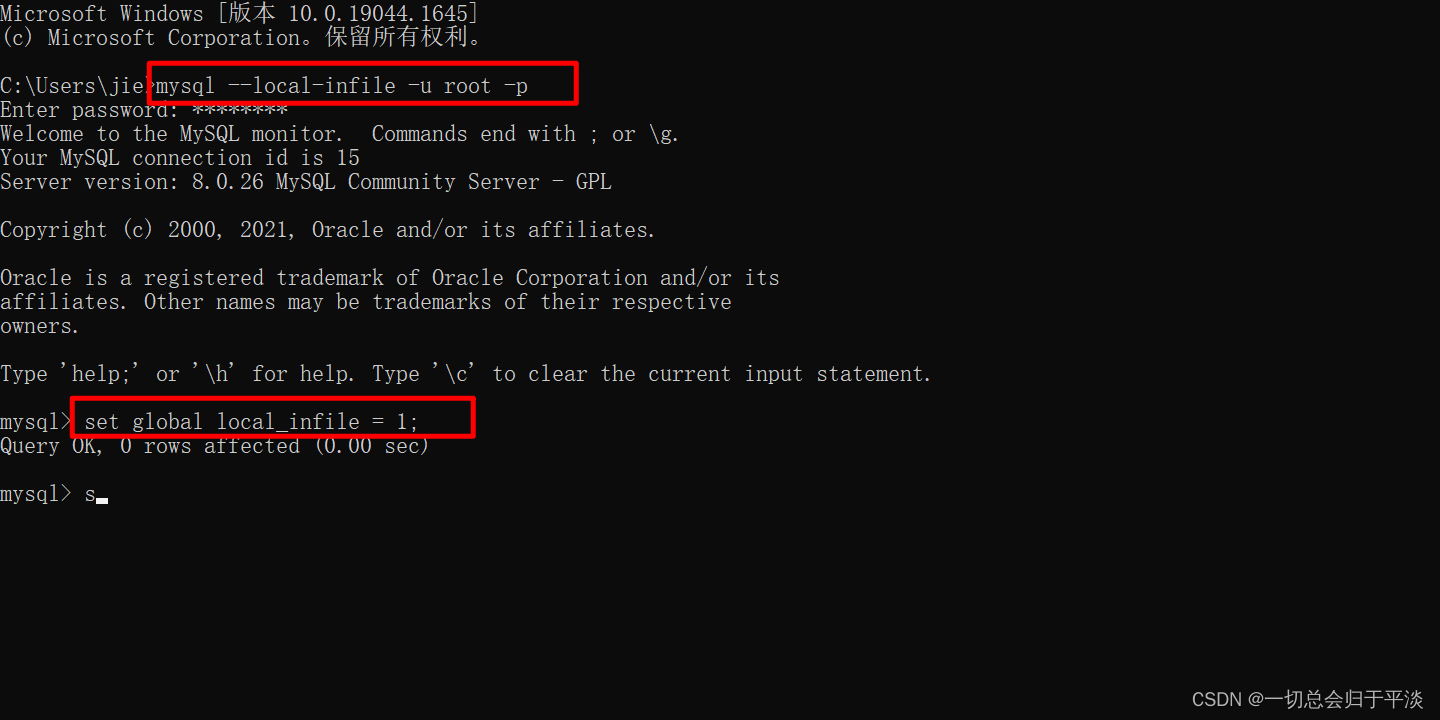

-- 客户端连接服务端时,加上参数 -–local-infile mysql –-local-infile -u root -p -- 设置全局参数local_infile为1,开启从本地加载文件导入数据的开关 set global local_infile = 1;

3、load加载数据,记得先切换到相关数据库下

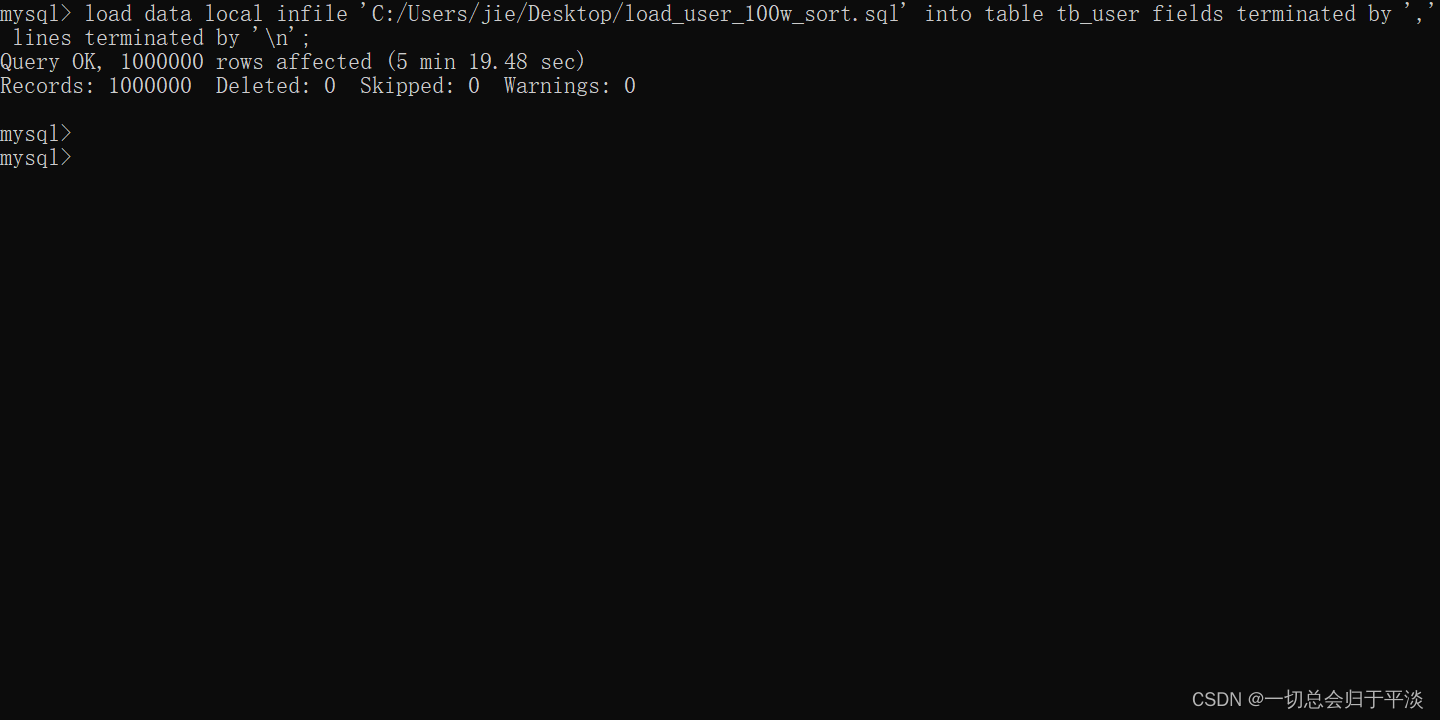

load data local infile 'C:/Users/jie/Desktop/load_user_100w_sort.sql' into table tb_user fields terminated by ',' lines terminated by 'n';

我这小破电脑跑得还行,不知道大家的电脑跑起来怎么样。

注:在load时,主键顺序插入性能高于乱序插入

2、主键优化

2.1 数据组织方式

在InnoDB存储引擎中,表数据都是根据主键顺序组织存放的,这种存储方式的表称为索引组织表(index organized table IOT)。

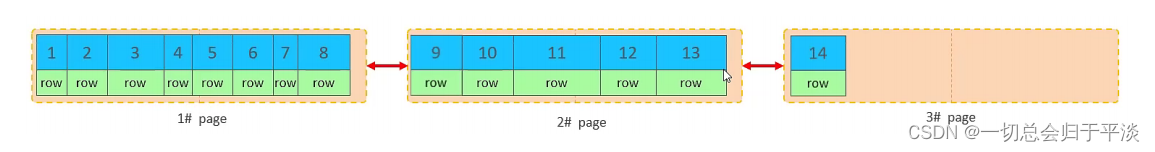

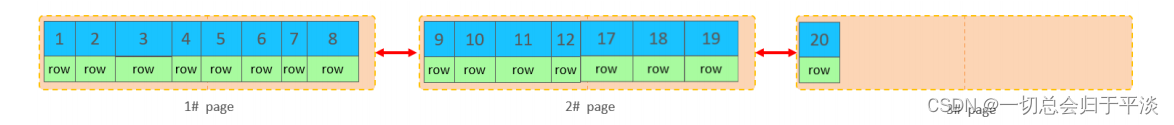

在InnoDB引擎中,数据行是记录在逻辑结构 page 页中的,而每一个页的大小是固定的,默认16K。

那也就意味着, 一个页中所存储的行也是有限的,如果插入的数据行row在该页存储不小,将会存储到下一个页中,页与页之间会通过指针连接。

2.2 页分裂

页可以为空,也可以填充一半,也可以填充100%。每个页包含了2-N行数据(如果一行数据过大,会行溢出),根据主键排列。

1、主键顺序插入效果

从磁盘中申请页,主键顺序插入,当第一页数据写满之后,再写入第二个页,页和页之间通过指针连接,第二页写满之后,再往第三页写入,以此类推。

2、主键乱序插入效果

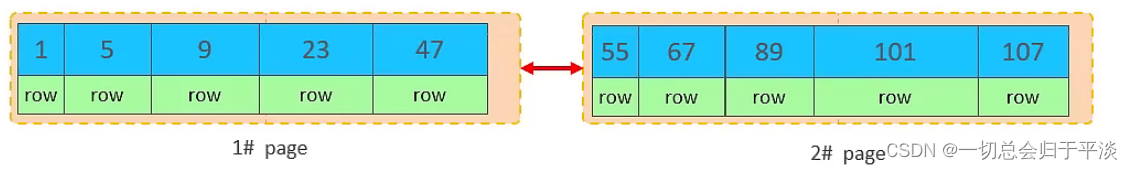

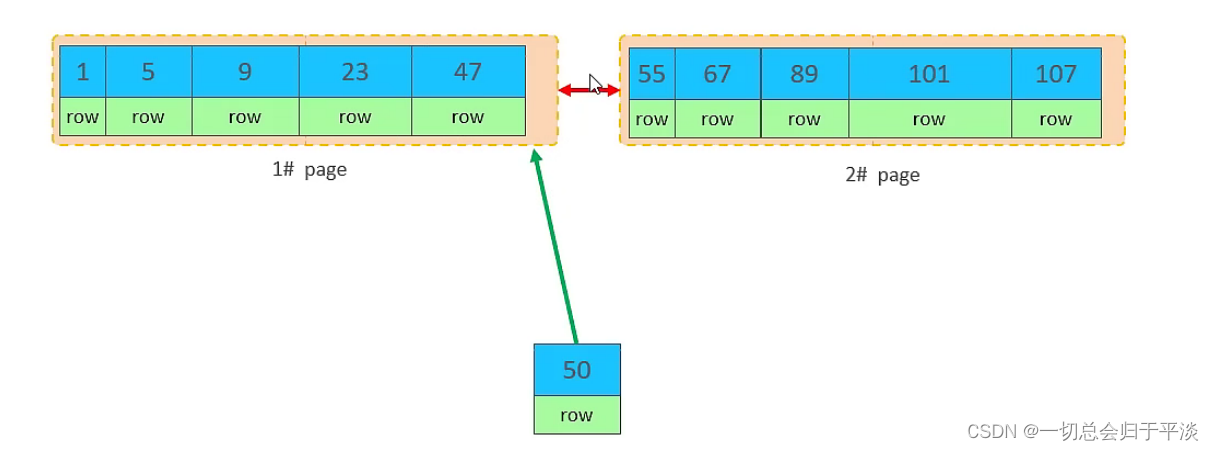

第一页和第二页都写满了数据。

此时再插入id为50的记录的话,因为索引的叶子节点是有顺序的。按照顺序,应该存储再47之后,所以不会写入到新的页中。

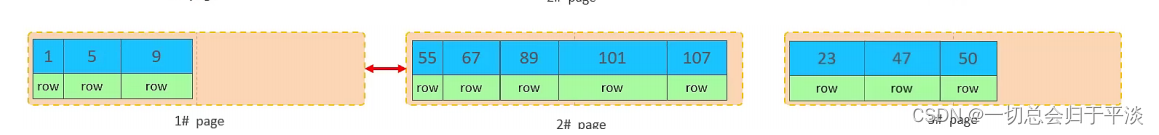

但是!47所在的第一页它已经满了呀,那么这个时候就会开辟新的一页,来存储50,但是并不会直接将50存入第三页,而是将第一页后一半的数据,移动到3页,然后才在第三页插入50。

移动数据,并插入id为50的数据之后,那么此时,这三个页之间的数据顺序是有问题的。 第一页的下一个页,应该是第三页, 第三页的数据的下一个页是第二页。 所以,此时,需要重新设置链表指针。

上述的这种现象,称之为 "页分裂",是比较耗费性能的操作。

2.3 页合并

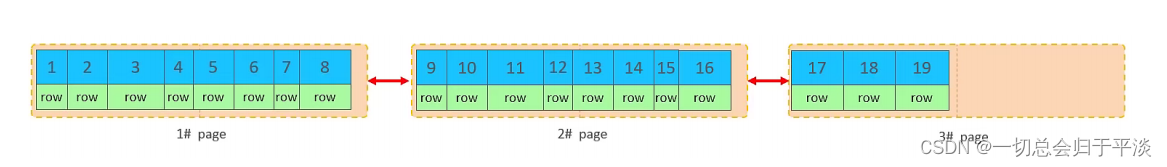

现在有三页数据。

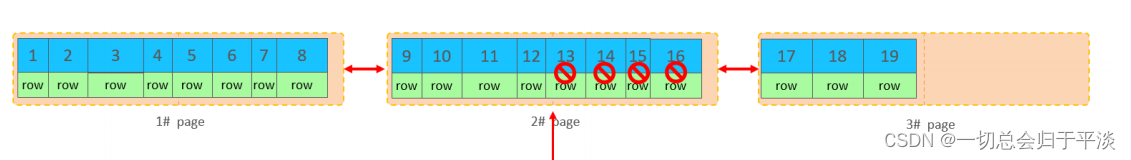

我们现在对第二页删除4条数据。

注:当删除一行记录时,实际上记录并没有被物理删除,只是记录被标记(flaged)为删除并且它的空间变得允许被其他记录声明使用。

像这样当页总删除的记录达到 MERGE_THRESHOLD(默认为页的50%),InnoDB会开始寻找最靠近的页(前或后)看看是否可以将两个页合并以优化空间使用。

这个时候才物理删除数据,再将页进行合并,如果这时候插入新的数据。则直接写入第三页。

这个里面所发生的合并页的这个现象,就称之为 "页合并"。

注:

MERGE_THRESHOLD:合并页的阈值,可以自己设置,在创建表或者创建索引时指定。

2.4 主键设计原则

-

满足业务需求的情况下,尽量降低主键的长度。

-

插入数据时,尽量选择顺序插入,选择使用AUTO_INCREMENT自增主键。

-

尽量不要使用UUID做主键或者是其他自然主键,如身份证号。

-

业务操作时,避免对主键的修改。

3、order by 优化

MySQL的排序,有两种方式:

Using filesort : 通过表的索引或全表扫描,读取满足条件的数据行,然后在排序缓冲区sortbuffer中完成排序操作,所有不是通过索引直接返回排序结果的排序都叫 FileSort 排序。

Using index : 通过有序索引顺序扫描直接返回有序数据,这种情况即为 using index,不需要额外排序,操作效率高。

对于以上的两种排序方式,Using index的性能高,而Using filesort的性能低,我们在优化排序操作时,尽量要优化为 Using index。

测试:

我现在就用上面导入了百万数据的tb_user做测试。

先来执行以下SQL:

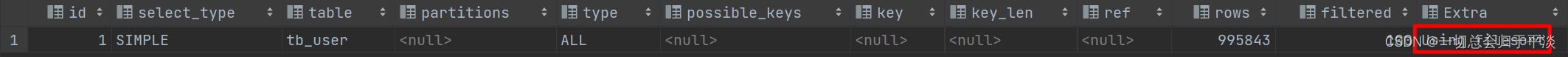

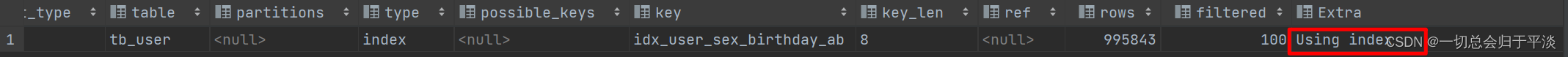

explain select id,birthday ,sex from tb_user order by sex,birthday ;

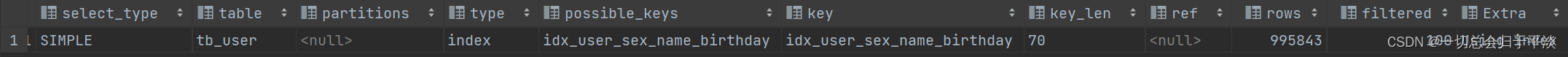

由于 sex, birthday都没有索引,所以此时再排序时,出现Using filesort, 排序性能较低。那我们就给它们创建联合索引。

create index idx_user_sex_birthday_aa on tb_user(sex,birthday);创建完索引之后,我们再执行一次explain 语句。

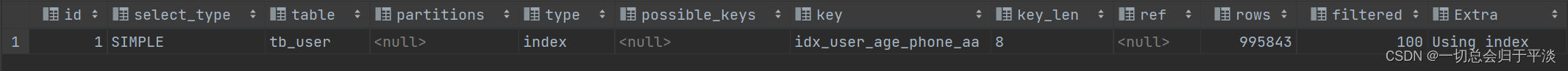

建立索引之后,再次进行排序查询,就由原来的Using filesort, 变为了 Using index,性能就是比较高的了。

我们现在试试将降序排序。

explain select id,birthday ,sex from tb_user order by sex desc ,birthday desc ;

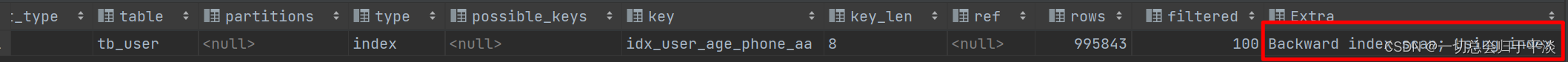

也出现 Using index, 但是此时Extra中出现了 Backward index scan,这个代表反向扫描索引,因为在MySQL中我们创建的索引,默认索引的叶子节点是从小到大排序的,而此时我们查询排序时,是从大到小,所以,在扫描时,就是反向扫描,就会出现 Backward index scan。

在MySQL8版本中,支持降序索引,我们也可以创建降序索引。

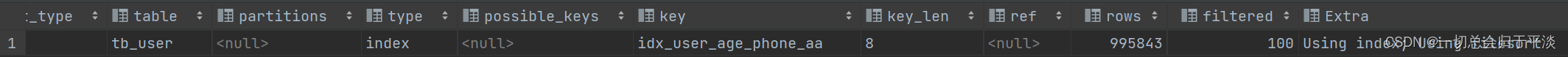

create index idx_user_sex_birthday_ab on tb_user(sex desc ,birthday desc );创建完成后,我们再降序排序查询一次。

此时就会是 Using index。

还有一种情况的查询就是根据sex, birthday进行降序一个升序,一个降序

explain select id,birthday ,sex from tb_user order by sex asc ,birthday desc ;

因为创建索引时,如果未指定顺序,默认都是按照升序排序的,而查询时,一个升序,一个降序,此时就会出现Using filesort。

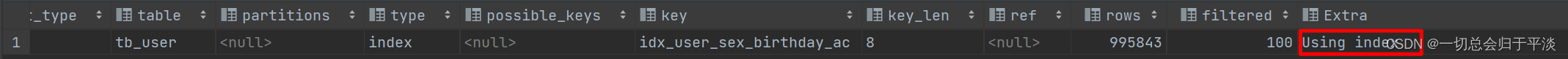

这个时候我们可以根据排序再创建一个索引。

create index idx_user_sex_birthday_ac on tb_user(sex asc ,birthday desc );然后再执行SQL语句查询。

这不就又是 Using index。

由上述的测试,我们得出order by优化原则:

根据排序字段建立合适的索引,多字段排序时,也遵循最左前缀法则。

尽量使用覆盖索引。

多字段排序, 一个升序一个降序,此时需要注意联合索引在创建时的规则(ASC/DESC)。

如果不可避免的出现filesort,大数据量排序时,可以适当增大排序缓冲区大小sort_buffer_size(默认256k)。

4、group by优化

首先我先把tb_user 表索引全部删除先。

drop index idx_user_sex_birthday_aa on tb_user;

drop index idx_user_sex_birthday_ab on tb_user;

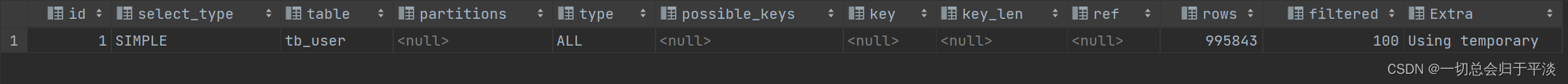

drop index idx_user_sex_birthday_ac on tb_user;接下来,在没有索引的情况下,执行如下SQL,查询执行计划:

explain select sex , count(*) from tb_user group by sex ;

然后,我们在针对于 sex, name, birthday创建一个联合索引。

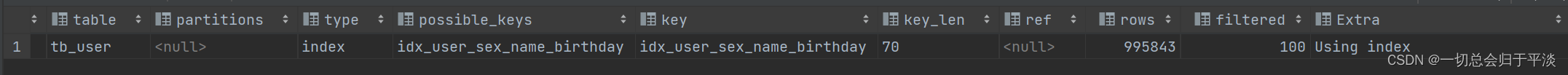

create index idx_user_sex_name_birthday on tb_user(sex , name , birthday);紧接着,再执行前面相同的SQL查看执行计划。

再执行如下的分组查询SQL,查看执行计划

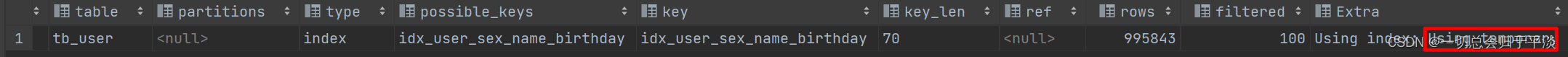

explain select sex , count(*) from tb_user group by name,birthday ;

explain select sex , count(*) from tb_user group by name ;

我们发现,如果仅仅根据name分组,就会出现 Using temporary ;而如果是根据 sex,name两个字段同时分组,则不会出现 Using temporary。原因是因为对于分组操作,在联合索引中,也是符合最左前缀法则的。

所以,在分组操作中,我们需要通过以下两点进行优化,以提升性能:

在分组操作时,可以通过索引来提高效率。

分组操作时,索引的使用也是满足最左前缀法则的。

5、limit优化

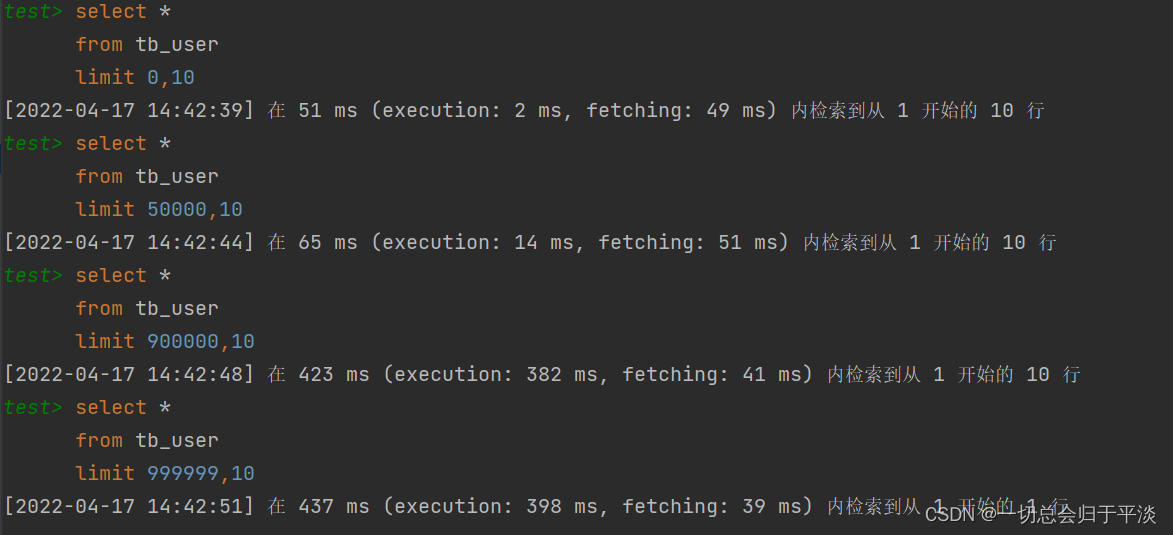

在数据量比较大时,如果进行limit分页查询,在查询时,越往后,分页查询效率越低。我们一起来看看执行limit分页查询耗时对比:

通过测试我们会看到,越往后,分页查询效率越低,这就是分页查询的问题所在。

优化思路: 一般分页查询时,通过创建 覆盖索引 能够比较好地提高性能,也可以通过覆盖索引加子查询形式进行优化。

explain select * from tb_user t , (select id from tb_user order by id limit 999999,10) a where t.id = a.id;6、count 优化

MyISAM 引擎把一个表的总行数存在了磁盘上,因此执行 count(*) 的时候会直接返回这个数,效率很高; 但是如果是带条件的count,MyISAM也慢。

InnoDB 引擎就麻烦了,它执行 count(*) 的时候,需要把数据一行一行地从引擎里面读出来,然后累积计数。

如果说要大幅度提升InnoDB表的count效率,主要的优化思路:

自己计数,可以借助于redis这样非关系型的数据库进行,但是如果是带条件的count又比较麻烦了。

count()是一个聚合函数,对于返回的结果集,一行行地判断,如果 count 函数的参数不是 null,累计值就加 1,否则不加,最后返回累计值。

| count 用法 | 含义 |

|---|---|

| count(主 键) | InnoDB 引擎会遍历整张表,把每一行的 主键id 值都取出来,返回给服务层。 服务层拿到主键后,直接按行进行累加(主键不可能为null) |

| count(字 段) | 没有not null 约束 : InnoDB 引擎会遍历整张表把每一行的字段值都取出来,返回给服务层,服务层判断是否为null,不为null,计数累加。 有not null 约束:InnoDB 引擎会遍历整张表把每一行的字段值都取出来,返回给服务层,直接按行进行累加。 |

| count(数 字) | InnoDB 引擎遍历整张表,但不取值。服务层对于返回的每一行,放一个数字“1”进去,直接按行进行累加。 |

| count(*) | InnoDB引擎并不会把全部字段取出来,而是专门做了优化,不取值,服务层直接按行进行累加。 |

按照效率排序的话,count(字段) < count(主键 id) < count(1) ≈ count(*),所以尽

量使用 count(*)。